本文来自微信公众号:虎嗅APP(ID:huxiu_com),作者:齐健、陈伊凡,编辑:陈伊凡,头图:Pixabay。

“一场针对AI的‘完美风暴’正在形成。”一位产业投资人如此描述。

一时间,街头巷尾都在热议一个叫做ChatGPT的产品,ChatGPT相关概念股一度猛涨。一家大数据公司创始人表示,已经有客户咨询,是否能在他们的产品里结合ChatGPT。

在经历了2016年,由AlphGo击败李世石而掀起的AI浪潮后,AI行业沉寂良久,上一波浪潮里起来的AI算法公司,在硬件化和数据的泥沼里寻找出路,这么多年,AI行业太需要一个现象级的故事了。ChatGPT的出现,就如同点亮了灯泡,让这个行业再度以如此高光的姿态回到公众视野。只是,与上一波AI浪潮不同,这次的主角,从谷歌的AlphGo,变为微软的OpenAI。

风吹得太快了。

1月17日,微软CEO Satya Nadella公开表示要将OpenAI产品与自身生态结合,将ChatGPT加入到Bing、Office、GitHub、Azure等微软“全家桶”中。随后的一周中,微软又宣布向OpenAI追加数十亿美元投资。近期,OpenAI更是公布了ChatGPT最新的订阅制商业模式。

北京时间2月7日凌晨,谷歌突然发布了基于谷歌LaMDA大模型的下一代对话AI系统Bard。同一天,百度也官宣了正在研发的文心一言(ERNIE Bot)项目,计划在3月完成内测,随后对公众开放。

北京时间2月8日凌晨(美国当地时间2月7日),微软宣布,推出由ChatGPT支持的最新版本Bing(必应)搜索引擎和Edge浏览器。Satya Nadella表示,“搜索引擎迎来了新的时代”。微软称必应构建在新的下一代大型语言模型上,比ChatGPT更强大,并且能帮助其利用网络知识与OpenAI的技术进行智能对接。

24小时内,三家科技巨头躬身入局、抢占高地。这股风不仅快,而且猛。

“谷歌可能只需要一两年时间,就会被彻底颠覆。”Gmail创建者之一、谷歌老员工Paul Buchheit近日公开表示,ChatGPT将彻底摧毁谷歌赖以生存的搜索引擎。

ChatGPT是人工智能研究机构OpenAI在2022年11月底发布的生成式AI对话大模型。上线一个多月,ChatGPT就把OpenAI的估值从200亿美元推高到290亿。如果其商业化大规模推进,或许我们的后世子孙将很难想象,人类曾需要自己构思文案或自己写程序代码。正如我们难以想象的计算机要占一个房间那么大。

作为一家限制营利(Capped-Profit)型企业,OpenAI在AI领域的研究并非只为赚钱。但ChatGPT似乎正在把OpenAI“逼”到赚钱的风口上。据外媒The Information爆料,OpenAI计划在2023年实现2亿美元营收,2024年底前,营收达10亿美元。

投资机构红杉美国在2022年发布的一篇分析文章《Generative AI: A Creative New World》中提到,生成式AI有潜力产生数万亿美元的经济价值。如今,作为AIGC领域其中一个代表性产品,ChatGPT的爆火正在印证这一预言。

“ChatGPT是多个底层技术积累和市场成熟到一定程度的产物,”一位产业投资人如此概括他对于这款现象级产品的理解,他将ChatGPT类比iPhone,虽不是第一款智能手机,但却是最成功的一个。

也正如iPhone催生出了一系列智能手机APP,一波应用型公司正在基于GPT等生成式AI大模型迅速成长。在过去一年里,AIGC赛道正在催生出一个个独角兽。只是在这一个个造富神话的背后,越来越多人似乎也意识到,只有少数故事可以讲下去,还有很多故事可能讲不长久。

笔者通过与多位投资人、业内人士的交流,试图理清,在一、二级市场狂热背后,目前在AIGC上的商业模式,哪些可以跑出来,哪些难以为继。

AIGC的泡沫:还没吹起来,就要破了

AIGC(AI Generative Content,AI生成内容)顾名思义,是AI直接生产内容的技术形式。生成式AI并不是一个新事物,它由来已久,但2022年却被很多AI行业人士称为AIGC元年,开启“元年”概念的有两件大事,其一是ChatGPT的现象级爆火,使AIGC彻底出圈,大幅拉高了人们对AI能力上限的认知。另一件则是2022年8月图片生成大模型Stable Diffusion的开源,Stable Diffusion虽然并不算是非常强大的AIGC文生图模型,但是他的开源却让文生图这种能力“飞入寻常百姓家” ,这也成为了AIGC能够现象级爆火的条件之一。

Stable Diffusion是AI公司Stability AI和Runway共同开发的扩散式(Diffusion Models)图片生成大模型。与以往的生成式对抗网络(GAN, Generative Adversarial Networks)相比,扩散式模型生成图片的速度更快、质量更好。

随着AI绘图在社交媒体迅速蹿红,抖音和小红书上甚至有脑洞大开的网友提出,可以把AI生成的图片挂到付费图库作为收费资源,实现“躺赚”。一时间,AIGC文生图成了一门“有手就能干”的生意。

在这一批AIGC公司中不乏几家独角兽,其中就包括利用OpenAI大模型实现商业落地的Jasper和前面提到的Stable Diffusion的研发公司之一Stability AI。

OpenAI凭借多年积累的大模型研发能力,以及GPT、DALL-E等产品,一枝独秀。而其他一众独角兽企业,虽然估值与OpenAI相去甚远,但无一不是在短时间内估值暴增,Jasper甚至只是一家基于OpenAI技术的服务商,估值也达到了15亿美元。Anthropic更是凭借创始人的GPT元老身份,以“ChatGPT最强竞品”的噱头,被危机中的谷歌看中,估值直逼50亿美元。

据第三方研究机构PitchBook的数据, 2022年海外投资者在AIGC赛道至少投入13.7亿美元,完成78笔交易,相当于前五年投资额之和。

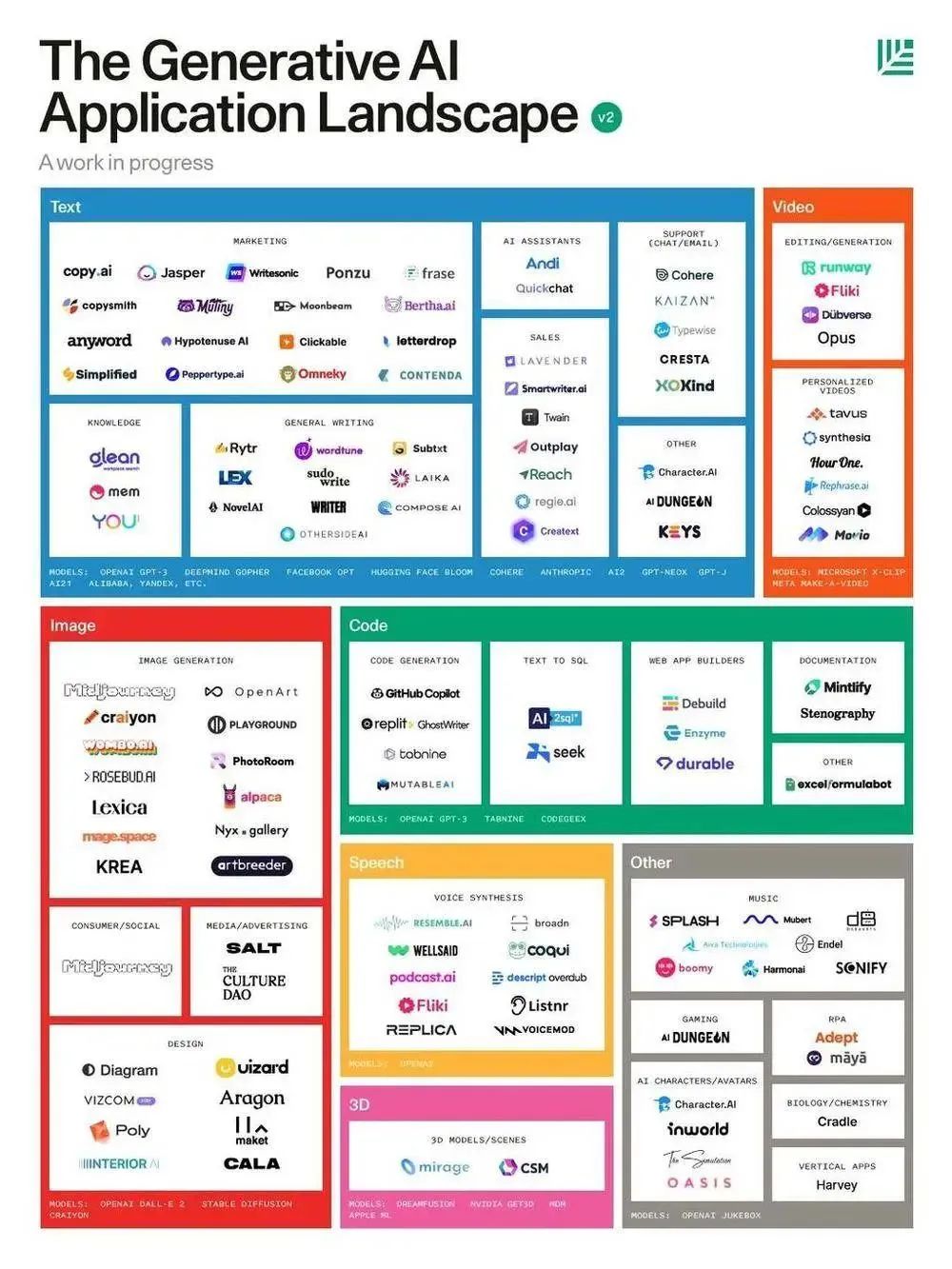

在这场投资热潮中,美国公司走得更快。根据红杉2022年10月发布的海外AIGC厂商图谱,在大模型、文生文、文生图、代码等细分领域已经出现了不少初创公司。笔者根据公开资料整理了部分中国AIGC公司的图表,中国的AIGC公司主要集中在A轮甚至天使轮,主要是在应用端的创新。

海外AIGC厂商图谱

海外AIGC厂商图谱

国内部分AIGC公司

国内部分AIGC公司

虽然资本热捧,现象级应用层出不穷,创业项目也是一抓一大把,但无论在文生文还是文生图领域,AIGC目前几乎没有看到任何一条特别明确且长久的变现途径。被称为ChatGPT商业化的收费模式,实际上线后或许也只能勉强填补一部分天价运营费用的窟窿。

在资本方面,很多AIGC的早期投资人甚至已经开始考虑撤出这条赛道了。“在AIGC赛道上,吆喝多,真正融到钱的不多。”AI绘图App Draw Things的开发者Liu Liu告诉笔者,投资向头部企业集中就是最明显的现象。从投资人角度看,在经济下行的时候投资AI行业的头部企业肯定会比较保险。“另一方面,投资人也会担心这个行业像上一波深度学习热潮一样,最终只能惠及大公司,而小公司很难‘冒头’。”

泡沫似乎还没有完全吹起来,就要被戳破了。

在AIGC赛道,已经有公司开始“摔倒”。2022年12月28日,AI绘画公司StockAI宣布将停止为用户提供AI绘图服务,开始进行业务转型。目前的StockAI平台已正式关闭,用户订阅计划均被取消。该公司称关停服务是因为AI绘图的运营成本过高,目前的付费用户群无法支付这笔费用。

“智源在大模型方向布局比较早,如今已经不会刻意追AIGC项目了。”北京智源人工智能研究院(简称“智源研究院”)、智源创投基金投资总监向其奇认为,目前国内的AIGC已进入“开卷考试”阶段,多数AIGC项目看起来很美,但实际上核心竞争力不足,整体有些虚胖。作为与OpenAI在组织方式和研究方向都相似的机构,智源研究院也一直关注国内AI领域的优质早期项目。

一边是AIGC头部公司获得海量资金,催生新晋独角兽;另一边则是初创AIGC公司关停业务。AIGC元年刚过,这条赛道上的公司就出现了一些两极分化的现象。那么,不同公司以AIGC为技术载体实践的商业模式到底成功率几何?谁能跑出来?又有多少模式可以被复制?

缺乏核心竞争力的独角兽

“许多AIGC的公司,或许能生存3年-5年,但要让他们继续讲更长的故事,就很难了。”不止一位投资人向笔者表达了这样的判断。

在ChatGPT爆火之前,2020年问世的大模型GPT-3在业界已经掀起了不小的波澜,此后OpenAI也有了Viable、Duolingo、Notion等不少值得标榜的API(Application Programming Interface,应用程序编程接口)落地案例,基于大模型进行商业化的探索,其中最成功的当属Jasper。

成立于2020年的Jasper,是基于GPT-3的API为用户提供AI写作服务的初创公司,Jasper在AI写作领域并不算是“早鸟”,但却是最先开始调用GPT-3 API的公司之一。作为底层大模型,GPT-3对于普通用户来说,还不能直接使用,需要专业的AI研究人员在大模型的基础之上进行参数调试和优化。

Jasper的核心业务就是通过优化GPT-3模型的使用体验,充当普通用户和OpenAI之间的“中间商”。2022年,Jasper成功募资1.25亿美元,估值达15亿美元。这对于一家成立两年的AI公司来说,估值并不算低。毕竟,2019年微软注资OpenAI时一次就花了10亿美金。Jasper比较擅长输出电商产品介绍,博主的种草文案等短篇内容。虽然文章质量一般,但文字内容多数情况下通顺可读,没有明显的语法错误。

2021年Jasper营收近4000万美元,2022年收入更是有望翻倍。虽然公布的数据很好看,但很多业内人士对Japer的赚钱能力持怀疑态度,毕竟这几千万美元只是营收,除去运营过程中的生产、研发、推广等成本后,还能剩下多少实在不好说。

从目前OpenAI公布的API价格来看,基础模型生成文字大概是每750个词0.4美元,Jasper的价格则是基础服务月费29美元,可以生成20000个词。中间差价不到17美元,这17美元涵盖了Jasper提供的50+模板、29+语言服务。如果买的量大,高级月费服务还包括SEO(Search Engine Optimization,搜索引擎优化)等一系列其他的服务。

能否有持续足够的技术和资金跟上每一次模型的迭代,是这些在大模型之上做应用的公司都需要面临的极大挑战。

“虽然GPT-3/3.5模型已经很好了,但类似Jasper的下游应用企业要提供垂直领域的专业服务,仍然需要基于行业知识自建知识库和模板,并对GPT-3/3.5模型进行Finetune(微调),这部分的研发成本也相当高。”智源研究院创新应用实验室负责人史业民认为,因为在大模型和用户之间多了一个中间环节,还要产生很多人员、运营等额外费用。还有一点更为重要,那就是直接利用底层模型API的成本和风险是有可能随着OpenAI的业务调整发生变化的。

那么,如果没有中间环节会怎么样?如果底层模型直接和用户对接,Jasper的价值又在哪里?

这也是Jasper面临的困境。如Jasper一样调用API的公司,是OpenAI现阶段的主要收入来源。在ChatGPT爆火之后,一些Jasper的用户发现了ChatGPT能生成比Jasper更好的内容,等于是“代理转直销”了。面对来自OpenAI的压力,Jasper首席执行官Dave Rogenmoser表示:“ChatGPT可以做很多事情,但它缺乏大企业客户需要的功能。我们将自己视为将AI能力引入企业的人。”

Dave Rogenmoser的解释好像还不够有说服力。毕竟,已经有客户直接找到OpenAI了。2023年1月26日,美国版“今日头条”BuzzFeed宣布,将与OpenAI开展合作,使用ChatGPT创作新闻内容。BuzzFeed联合创始人兼首席执行官Jonah Peretti在邮件中指出:今年,AI创作的内容将从研发阶段转变为核心业务的一部分。消息一出,BuzzFeed股价连涨两天,翻了3倍。OpenAI还没来得及为这波“获客”吹牛,客户倒先开始标榜自己是ChatGPT的实践先锋。

即便如此,Jasper的商业落地仍给很多AI创业者提供了想象空间,而且只要入局够早,就能抢占先机,也不是所有企业都具备BuzzFeed的这种直接对接大模型公司的能力。一家AIGC创业公司创始人认为,能像OpenAI一样不在乎盈利,保持多年烧钱研究的企业或机构并不多,如果没有大量Jasper这样的应用层公司,则很难承托起OpenAI这样的AI大模型类的PaaS(Platform as a Service,平台即服务)公司。

中国也出现一些公司,正在模仿海外的商业模式。但“橘生淮南则为橘,生于淮北则为枳”,简单的复制,很多时候并不能适应中国的土壤。

Jasper模式要落地中国最致命的硬伤是,国内目前没有一款可以媲美GPT的大模型,而OpenAI的API业务,起码迄今为止对中国用户并不友好,并不官方支持中国的API调用。此外,即便中国企业可以调用,ChatGPT或是GPT-3的训练主要使用英文数据训练,中文表现与英文还有差距。

另一方面,就是商业的底层逻辑——赚钱。由于大模型优化成本很高,盈利压力自然也会增加。从微软的Azure OpenAI目前提供的GPT-3微调训练托管价格来看,要在Auzre云上进行GPT-3的优化工作,每小时的成本约20-84美元,这个费用还只是不包括算力的单个模型费用。

从目前的中国市场环境来看,不管是SaaS模式的付费意愿,还是人力成本可能都不足以支撑Jasper的商业模式。

在Jasper的主要业务电商文案写作方向上,目前很多国内跨境电商对Jasper的AI写作服务都有所了解,但这种服务对于他们来说需求度并不高。亚马逊一个产品介绍大概200多个单词,按Jasper的入门计划20000词,可以给不到100款商品生成产品介绍。

一位跨境电商老板告诉笔者,虽然英文写作对一些国内跨境电商老板来说有点难度,但AI需求在这个圈子里并不大。请一个兼职大学生,月薪3000左右,基本就能覆盖多数跨境电商的所有上架需求了,能修图、做表格、回邮件,这些都是工作分内的事儿。多数电商没有那么多文案需求,“单独购买文案生成服务就相当于多给兼职工买一套Office,完全没有必要。”前述跨境电商老板表示。

同时,AIGC生成的内容仍存在很多不确定性。硅基智能创始人司马华鹏表示,“目前我们的纯AI数字人已可以实现连续直播400小时。但很多企业在初次尝试数字人直播时仍存在一定风险和门槛,很容易因为内容质量差或敏感信息触发直播平台对AI数字人直播的限制。在AI数字人的内容训练过程中,有时需要对NLP进行内容更符合用户需求的预设。”

商业模式难以为继的文生图公司

相比于文生文领域的Jasper,在文生图领域,与Jasper估值相似的另一家著名独角兽Stability AI则显得更不落地。

起码Jasper已经在文生文领域探索出了比较明确的商业化目标用户,其他创业公司只要沿着这条路继续探索就可以了。但AIGC文生图、文生视频、文生3D模型等赛道还处在很早期的阶段,在北美市场的成功经验中,Lensa AI和Midjourney的主要客户都还在通过流量积累的C端客户的阶段。

2022年10月,文生图公司Stability AI完成了1.01亿美金的种子轮融资,估值达10亿美金。虽然Stability AI在AIGC文生图领域探索的时间不长,但文生图赛道的拥挤,却是它与合作伙伴Runway一手造成的。这两家公司共同推出的Stable Diffusion模型选择了开源模式,把AI绘图的能力免费交付到了每个人手中,但公开这项能力,却只是给Stability AI及RunwayML的模型能力做了背书,而他们怎么用这项能力赚钱呢?

目前,文生图领域的很多初创企业所提供的服务还只是在Stable Diffusion模型基础上的交互界面和生成图像的云服务,虽然多数公司都有销售token(代币)的付费AI绘图模式,但多数用户使用免费模式就已经足够了。

Lensa AI App于2018年上线,原本的主要用途是图片编辑和美化。2022年11月Lensa AI上线了魔法头像(Magic Avatars)功能,可以根据用户上传的人像图,自动生成各种不同风格的人脸照。魔法头像上线以后,LensaAI在11月30日至12月14日,连续两周位列美国及十多个国家的AppStore免费榜榜首。根据数据分析公司Sensor Tower的数据,该应用程序在12月的前12天在全球范围内安装了约1350万次,消费者在此期间的消费约2930万美元。

Midjourney走得更早,他们通过在线聊天社区Discord为用户提供AIGC文生图服务,Midjourney给用户提供25张免费图片,此后则以最低每月10美元的价格收费。目前该公司声称自己的月活用户数已超过100万。

虽然这两家公司均已具备了一定的付费用户基础,但云服务、模型研发成本巨大。目前来看,C端用户的付费意愿和购买力是否能够形成稳定的商业模式,从而支撑这些服务厂商的长远发展还都是未知数。

“C端用户很容易拉进来,但很难维持新鲜度。”AIGC创业公司6penAI负责人王登科对笔者表示,目前AI绘图最主要的用户围绕在C端,但这部分用户一般就是图个新鲜,最多半年,他们对AI绘图、AIGC的热度就会褪去。

相比之下,B端市场似乎更有发展潜力。在AI绘图的B端,目前已经有很多游戏工作室、美术工作室开始尝试提供AI绘图的相关服务了。

目前,国内游戏美术行业的立绘(游戏中的单个人物图)外包价格在6000~10000元不等,根据画师能力和经验,价格也会有所不同。猫事多游戏工作室负责人老李表示,AI绘图的单个角色相比人类要便宜很多,可能只有五分之一甚至十分之一的价格。而且可以根据客户需求同时产出50个相似造型、不同姿态,不同画面的图片,客户选定之后可以由美术进行细化精修工作。

不过老李接触的客户,也不是都能一下子接受AI绘图这种服务模型。

“我目前还没从AI绘图上看到生产力支持,AI能提供的帮助也就是找灵感吧。”这是国内一家游戏公司美术总监对AI绘图的评价。他的公司目前运营多个大型游戏IP,其中不乏爆款,但对于火了半年多的AI绘图,他却并不看好,“AI绘图随机性太大,能适用的范围很窄,而且图片不分层,修改成本很高。”

“AI绘图比较适合小型游戏工作室,尤其是那些IP要求不严格,或是从0到1的绘图需求,AI能帮助用户节省大量的美术成本,是实打实的生产力工具。”猫事多工作室AI技术总监黄峻认为,AI绘图最大的优势就是“给的多”。以往正常的美术外包模式是,客户提一份需求就画一张图,最多也就是前期沟通多一些,后期修改少一些。但AI绘图可以根据一个需求出100张图,给了客户更大的选择和想象空间。

黄峻介绍说:“我们用A100的云服务器训练AI,单个项目迭代500张图大概需要1天的时间。”因为AI模型是开源的,所以AI绘图外包的成本不高,目前AI绘图工作室的主要成本在于人类画师对AI的训练,以及训练过程中产生的云服务成本。老李则认为,AI绘图的关键在于节约用户的前期开发时间跟人力成本,把这部分转移到AI绘图的服务商。

除了时间和人力成本,云服务的成本也是AIGC的大头。不论是B端还是C端市场,不论服务挣不挣钱,提供服务肯定是要花钱的。笔者从多个提供AI绘图服务的供应商了解到,AIGC服务对GPU算力需求很大,有条件的供应商会选择用来NVIDIA A100 GPU的云服务器,这款服务器端价格相当高,而即便不用A100,云服务也并不便宜。

目前国内市场96G显存的单颗A100GPU服务器,算力报价大约是每小时28元,包年月费在13000元左右。史业民介绍说,智源研究院开发的Flag Studio绘图AI目前采用的是智源研究院自建的云服务器,算力需求大概是2-3台4核A100 GPU服务器,每月开支大概是50000元左右。

对于创业AI绘图公司来说,如果要维持一个可拓展,高性能,并且有一定显卡保有量的GPU集群,服务器的运营开支每月至少要5-10万元左右,然而在这样的开支规模下直接的回报却微乎其微。“王登科对笔者表示,目前多数AIGC公司都是在C端引流阶段,未来用什么样的商业模式去赚钱,大家都在摸索。

有开销,没进项,这或许正是前面提到过的StockAI关停服务的重要原因。不过王登科认为,在都采用开源模型的同质化竞争环境下,压缩云计算成本是AIGC创业公司的核心竞争力之一,目前6penAI在技术上改进了模型精度,并持续优化迭代时间,同时不断寻找低价服务器,已经可以将单张图片等成本压缩到1分钱以内了。

但不管是文生文还是文生图领域,这些基于GPT模型生长出来的应用层公司都在核心竞争力和商业模式上苦苦探索。

OpenAI的模式难以复制

“ChatGPT是一次产品和市场上的突破,而不是AI基础理论的突破。”一位行业资深投资人对笔者示,AIGC的大规模商用,需要三个条件,首先是基于技术积累而设计出超级模型,其次是有足够的数据去支持训练,第三,是要有算力和流量充足的平台来落地可持续的商业模式。对于背靠微软的OpenAI来说,有技术、数据、算力的优势,而微软旗下的Bing,也是一个自带流量的商业化平台。

正如iPhone的核心是供应链,如果类比到通用大模型上也是这样的道理,微软和谷歌这样的平台型公司就具有技术、数据、算力、流量的产业链优势。

上述投资人表示,AIGC产品一定迭代很快,ChatGPT是第一个出圈的产品,但不一定是商业上最成功的。

对于这一点,OpenAI创始人Sam Altman在接受美国著名风投基金Greylock合伙人Reid Hoffman采访时也表示:“将来应该会出现几个大型的基础模型,开发人员都将基于这些基础模型研发AI应用。但目前的情况依然是某一家公司开发出一个大型语言模型,然后开放API供他人使用。”

ChatGPT上线之后,一周之内就吸引了100万注册用户。甚至有大量开发者通过模拟浏览器代码的方式破解了ChatGPT的API(OpenAI并没有开放ChatGPT的API),一时间大量破解版的ChatGPT“二次开发”涌入GitHub。而近日OpenAI推出了名为ChatGPT Plus的20美元/月订阅版,给ChatGPT找了一条最快捷直接的变现道路。ChatGPT Plus的增值服务包括:高峰时段免排队、快速响应以及优先获得新功能和改进,OpenAI也表示会保留免费服务。

“AIGC在各个领域的应用都还处在极早期,这个行业爆火的最大好处应该是把大模型彻底带出圈了。”史业民认为,AIGC让公众了解到AI真的能做一些事情,在此之前AI行业花费了很大力气去教育市场了解AI,但很多企业对AI都持存疑态度。因为没有实际场景应用,就很难了解AI的上限到底有多高。

向其奇认为,大模型产业化和移动互联网有相似之处,最终都需要通过做应用来形成用户体验。而AIGC和移动互联网又有所不同,AIGC架构在大模型的能力之上,但国外大模型的API不一定给国内开放,国内的大模型还需要进一步优化升级,并且当前的商业模式也不是很清晰,所以短期热度虽高但很难长期吸引投资人关注,可能只有明星创业团队和行业老兵能持续融到钱。不过,他也认为,中国市场大、用户多,具有更多的可能性,在应用上来说,可能比美国市场更具优势。“很多应用体验在国内能打磨到极致,但在国外并不一定。”

从现在的AIGC技术和商业路径来看,未来AIGC赛道的参与者可能会有三种,底层模型研发公司,封装应用的开发者,以及利用应用给用户天提供专业化AIGC服务的供应商。

目前封装应用市场明显处在同质化竞争的阶段。例如AI绘图,各种应用都是基于Stable Diffusion的开源模型形成的产品。而调参服务则主要是基于行业经验提供服务。这两种业务都很容易被复制,且增长空间非常有限。

“AIGC只是一种应用形态,是个表象的技术。它背后的大模型才是核心。”史业民认为,OpenAI之所以会在ChatGPT推出之后迎来一波爆发式增长,就是因为ChatGPT以AIGC的形式向行业展现了他的大模型能力。

目前国内各家大厂、研究机构也都在生成式大模型上重点发力,相继发布了悟道、ERNIE、盘古等大规模预训练模型。在AIGC领域,智源研究院的Flag Studio,百度文心一格等都是基于自研模型推出的AIGC产品。

“整个AI行业未来的趋势可能就是几家大模型公司‘一统天下’。”史业民表示,从技术层面来说,构建大模型的数据和Feedback(反馈)会形成一个闭环,用的人越多,Feedback越多,模型也就有更多的数据支持迭代。“最后Feedback也会成为模型的一部分。这样早期玩家就会积累巨大的前期优势,导致新的选手完全没办法入局。”

这恐怕也正是微软、谷歌、百度等巨头都对AIGC、AI大模型领域如此看好的原因。然而国内在大模型的研究方面却走了几年弯路,由于AI“生成”内容的质量一直不理想,且理解类任务和多数大厂的现有业务息息相关,直接导致国内很多厂商都是从近几年才开始重视AIGC业务。

“AI大模型实际上已经算是信创产业(自主可控的信息技术应用创新产业)了。国内很多场景都要求保护数据,不太可能把数据放到美国的服务器上。同时,在大量政府、国央企应用场景中,文本的处理会涉及到很多机密。”一家AIGC创业公司创始人认为,即便OpenAI对中国全面开放API接口,在很多场景中仍然无法使用,“AI大模型一旦落后,追赶的成本会很高。虽然我国AI技术整体上发展不晚、也不慢,但在大模型领域同样面临‘卡脖子’的危机。”

不管怎么说,又一个AI行业的灯泡被点亮,真正的技术竞争刚刚开始。拥有数据的平台公司拥有生态优势,初创公司则专注差异化和互补性,而无论是在底层的大模型,还是AIGC的落地方面,各家企业都还要在热潮之下,冷静判断,看清前路,找到属于自己的赛道,跑下去。

本内容为作者独立观点,不代表创新湾立场。如有异议,请联系创新湾。创新湾聚焦新科技、新产业,相关内容欢迎投稿。(投稿或转载请联系创新湾小编微信:EnnoBay2020)

领先一步看见未来

创新湾ID:EnnoBay

.jpg)